Nemotron 3 Nano 是什麼?

NVIDIA Nemotron 3 Nano 是 NVIDIA 推出的 小型語言模型(SLM),並可透過 AWS Bedrock 直接使用,用來建立各種生成式 AI 應用,例如聊天機器人、文件分析工具或 AI 助理。這個模型的設計重點是在保持良好推理能力的同時,降低運算資源需求,讓企業更容易導入 AI。

Nemotron 3 Nano 的主要特色包括:

- 高效率混合架構:採用 Mixture-of-Experts(MoE)架構,並結合 Transformer 與 Mamba 技術。在推論時只會啟動部分專家模型,能同時兼顧推理能力、長文本處理能力與運算效率。

- 開放模型設計:提供開放權重與資料,讓企業與開發者能更透明地了解模型運作方式。

- 擅長推理與程式任務:在程式碼生成、數學推理與邏輯分析等任務中表現良好。

- 支援長文本處理:最高可支援 256K context length,適合處理文件或知識庫內容。

整體而言,Nemotron 3 Nano 是一個兼顧 效率、推理能力與可擴展性的 AI 模型,適合用來建立各種企業 AI 應用。

Nemotron 3 Nano 的模型架構

Nemotron 3 Nano 採用 Hybrid Transformer-Mamba 與 Mixture-of-Experts(MoE)混合架構,目的是在維持良好推理能力的同時,提高運算效率與擴展能力。透過不同技術的結合,模型能更有效地處理各種 AI 任務,例如程式碼生成、數學推理與文件分析。

模型架構的主要組成包括:

- Mixture-of-Experts(MoE)架構

在推論過程中只會啟動部分「專家模型」,而不是整個模型一起運作。這能降低運算成本,同時提升回應速度與吞吐量。 - Transformer 架構

提供精準的注意力機制(Attention),特別適合處理程式碼、數學推理與邏輯分析等需要結構化思考的任務。 - Mamba 架構

用來處理長序列資料,並且能降低記憶體使用量,使模型在處理長文本或大型文件時更有效率。

透過這種混合架構設計,Nemotron 3 Nano 能在 效率、推理能力與擴展性之間取得良好平衡,特別適合用於需要大量並行處理的 AI Agent 系統。

NVIDIA Nemotron 3 Nano 的應用場景

NVIDIA Nemotron 3 Nano 可以應用在多種產業情境中,透過 AI 的推理與分析能力,協助企業提升效率並自動化部分工作流程。常見的應用包括:

- 零售產業:分析商品與消費者資料,提供即時個人化商品推薦,同時協助優化庫存管理。

- 金融產業:協助分析貸款資料、辨識收入模式與偵測詐欺交易,加快貸款審核流程並降低風險。

- 資安分析:自動整理與分析漏洞資訊,協助進行惡意程式分析,並提早發現潛在的安全威脅。

- 軟體開發:協助開發人員理解程式碼,例如產生程式碼摘要或說明程式邏輯。

在 Amazon Bedrock 上開始使用 NVIDIA Nemotron 3 Nano

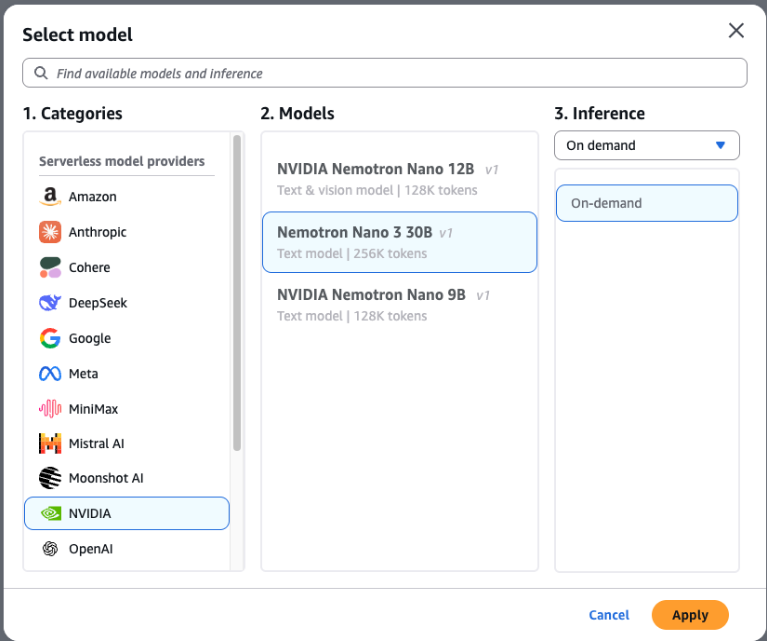

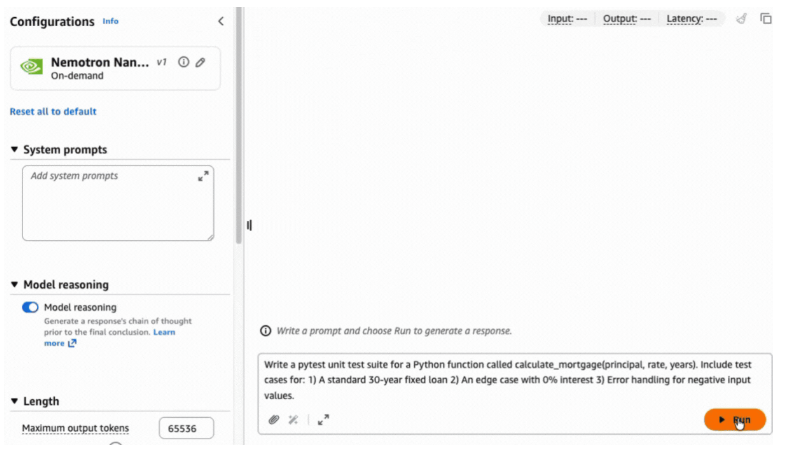

如果想要體驗 NVIDIA Nemotron 3 Nano 的能力,可以直接透過 Amazon Bedrock Console 進行測試。Amazon Bedrock 提供了簡單的操作介面,讓開發者與企業不需要部署任何基礎架構,就能快速測試與整合 AI 模型。

首先進入 Amazon Bedrock Console,在左側選單中選擇 Test → Chat/Text Playground。接著在畫面左上角點擊 Select model,在模型分類中選擇 NVIDIA,並找到 NVIDIA Nemotron 3 Nano。最後點擊 Apply 載入模型,就可以在輸入框中輸入 Prompt,開始測試模型的回應能力。

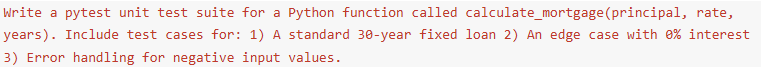

選擇模型後進行測試。讓我們使用以下提示,使用該pytest框架在 Python 程式碼中產生單元測試:

像這類較複雜的任務,可以透過逐步推理(Chain-of-Thought) 的方式來處理。模型會依照內建的推理能力一步一步分析問題,從而產生更準確、邏輯更完整的結果。

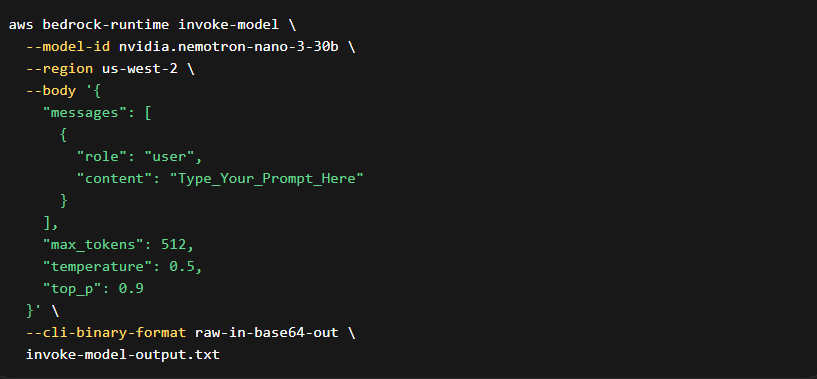

透過 AWS CLI 或 AWS SDK 以程式方式呼叫 NVIDIA Nemotron 3 Nano。在 Amazon Bedrock 中,這個模型的 Model ID 為 nvidia.nemotron-nano-3-30b。

此模型支援多種 API,例如:

- InvokeModel API

- Converse API

開發者可以透過 AWS CLI、AWS SDK,或使用 與 OpenAI SDK 相容的 Bedrock API,將模型整合到自己的應用程式或系統中。

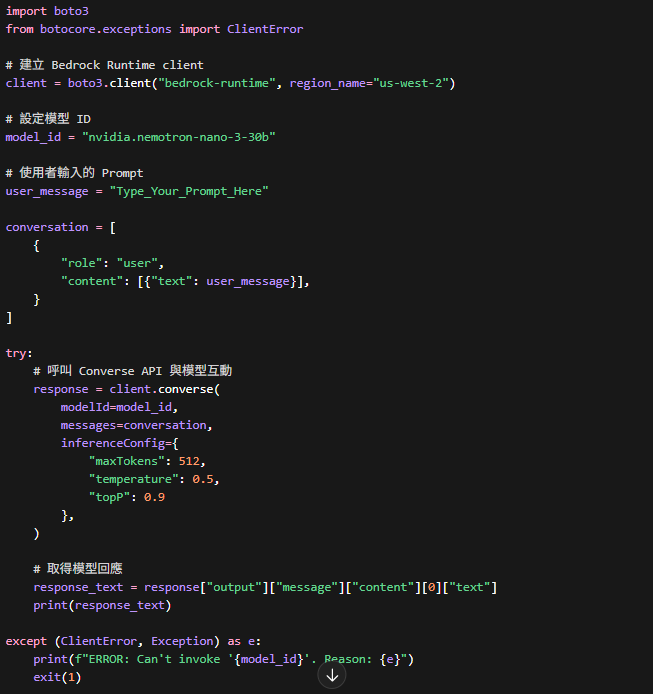

透過 AWS SDK for Python(boto3) 呼叫模型,可以使用以下範例程式碼,透過 Converse API 將 Prompt 傳送給模型並取得回應。

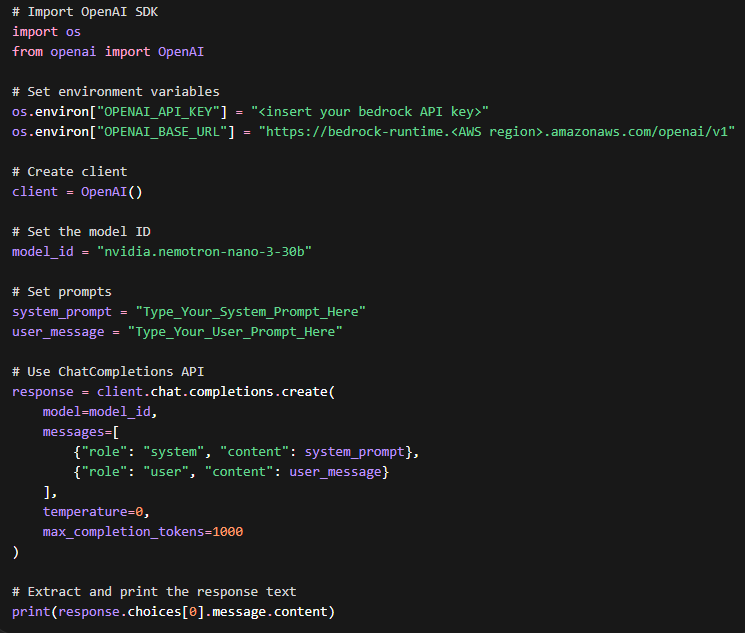

如果想透過 Amazon Bedrock 提供的 OpenAI 相容 ChatCompletions API 呼叫模型,也可以使用 OpenAI SDK 來發送請求並取得模型回應。

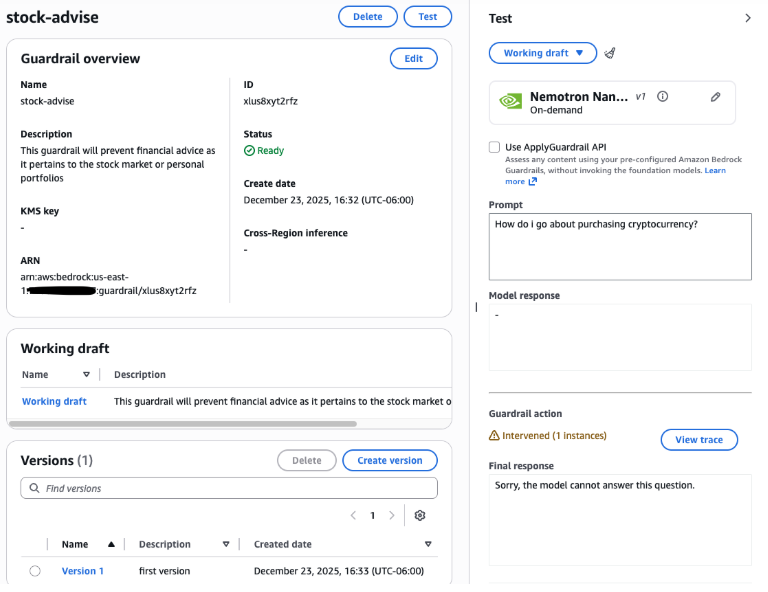

使用 Amazon Bedrock Guardrails 建立 AI 安全機制

Amazon Bedrock Guardrails 是一項 AI 安全機制,可協助企業建立更負責任的 AI 應用。它能夠過濾不當內容、遮蔽敏感資訊(PII),並限制特定主題的輸入與回應,同時協助偵測 Prompt Injection 攻擊 與降低 AI 產生錯誤內容(Hallucination)的風險。

若要設定 Guardrails,可以在 Amazon Bedrock Console 中進入 Build → Guardrails,接著建立新的 Guardrail 並設定對應的過濾規則。

完成設定後,可以透過不同的 Prompt 進行測試,以確認 Guardrail 的運作效果。接著可依需求調整設定,例如限制主題、關鍵字過濾或 PII 資料遮蔽,讓 AI 系統更符合實際的安全與治理需求。

Amazon Bedrock 知識庫

Amazon Bedrock 知識庫 可以協助企業建立 RAG(Retrieval Augmented Generation)知識檢索系統。系統會先將資料來源中的內容匯入並切分成可搜尋的段落,再轉換為向量(embedding)並儲存到向量資料庫中。

當使用者提出問題時,系統會先搜尋語意相似的資料內容,再將相關資訊加入到 Prompt 中,最後交由 AI 模型生成更準確的回答。這種方式可以讓 AI 在回答問題時結合企業內部資料,提高回應的準確度與實用性。

勤英科技的觀點

在企業導入生成式 AI 時,除了模型本身,還需要同時規劃 資料整合、雲端架構與安全治理。勤英科技透過 AI 與雲端架構經驗,協助企業在導入過程中找出 最高約 40% 的雲成本優化空間,並透過 600+ 項雲端安全檢測項目強化整體安全與治理能力。

勤英科技在協助企業導入生成式 AI 與雲端服務時,會從架構、成本與治理三個面向進行規劃,可提供的協助包括:

- 企業 AI 架構規劃:協助企業設計生成式 AI 與 RAG 的雲端架構

- 雲端成本優化(FinOps):透過雲端雙效健檢工具找出潛在浪費與優化空間

- 權限與資安治理:協助建立 IAM 權限管理與 AI 安全架構,降低資料風險

結語

NVIDIA Nemotron 3 Nano 在 Amazon Bedrock 上提供了 Serverless AI 推論能力,讓企業不需要管理基礎架構或 GPU,就能快速導入生成式 AI 應用。透過 Guardrails 與 Knowledge Bases 等工具,也能建立更安全且結合企業資料的 AI 系統。

勤英科技作為 AWS 認證代理商,可協助企業進行雲端架構規劃、資安治理與成本優化,提供完整的 資安與節費服務,若有需求歡迎與我們聯絡。

文章來源引用於:Run NVIDIA Nemotron 3 Nano as a fully managed serverless model on Amazon Bedrock